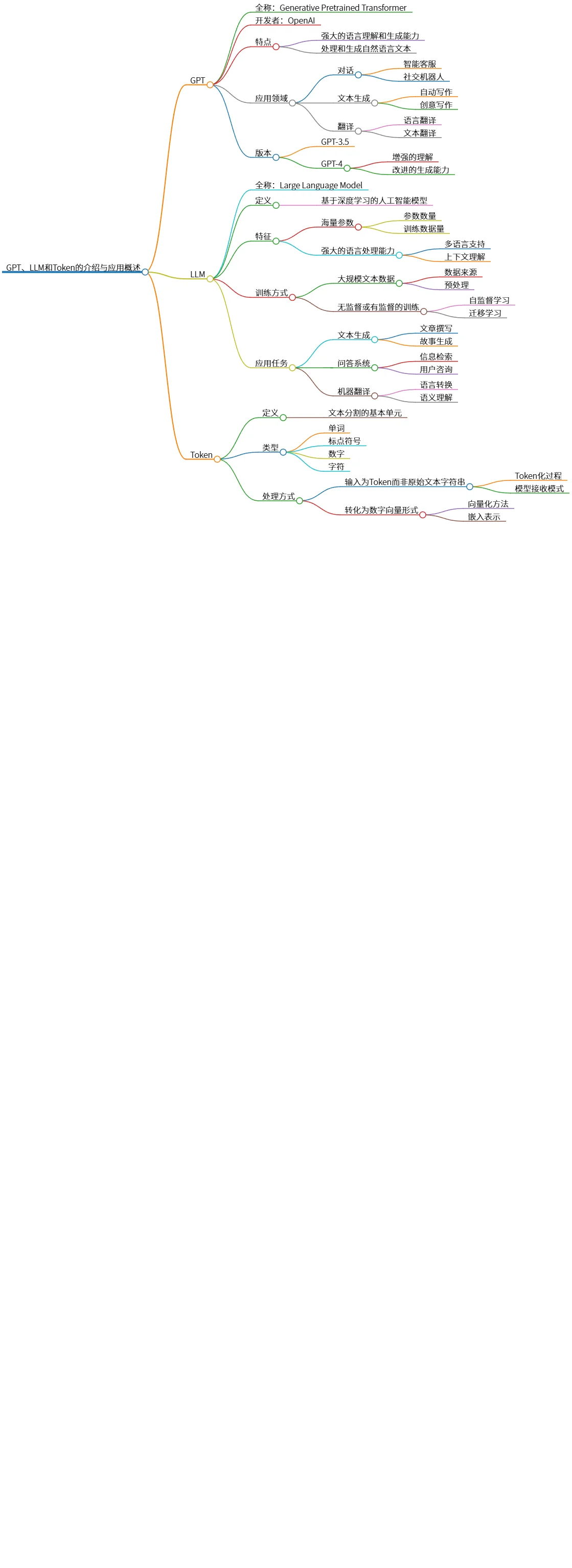

GPT、LLM和Token的介绍与应用概述

该思维导图介绍了GPT、LLM和Token的基本概念。GPT(生成预训练变换器)由OpenAI开发,具备强大的自然语言处理能力,广泛应用于对话、文本生成和翻译等领域。LLM(大型语言模型)基于深度学习,特征是大量参数和强大的语言处理能力,应用于文本生成、问答和机器翻译。Token是文本分割的基本单元,包括单词、标点符号、数字和字符,用于将输入文本转化为数字向量形式。

源码

# GPT、LLM和Token的介绍与应用概述

- GPT

- 全称:Generative Pretrained Transformer

- 开发者:OpenAI

- 特点

- 强大的语言理解和生成能力

- 处理和生成自然语言文本

- 应用领域

- 对话

- 智能客服

- 社交机器人

- 文本生成

- 自动写作

- 创意写作

- 翻译

- 语言翻译

- 文本翻译

- 版本

- GPT-3.5

- GPT-4

- 增强的理解

- 改进的生成能力

- LLM

- 全称:Large Language Model

- 定义

- 基于深度学习的人工智能模型

- 特征

- 海量参数

- 参数数量

- 训练数据量

- 强大的语言处理能力

- 多语言支持

- 上下文理解

- 训练方式

- 大规模文本数据

- 数据来源

- 预处理

- 无监督或有监督的训练

- 自监督学习

- 迁移学习

- 应用任务

- 文本生成

- 文章撰写

- 故事生成

- 问答系统

- 信息检索

- 用户咨询

- 机器翻译

- 语言转换

- 语义理解

- Token

- 定义

- 文本分割的基本单元

- 类型

- 单词

- 标点符号

- 数字

- 字符

- 处理方式

- 输入为Token而非原始文本字符串

- Token化过程

- 模型接收模式

- 转化为数字向量形式

- 向量化方法

- 嵌入表示

图片